« La décision médicale est forcément humaine. On n’imagine pas une intelligence artificielle prendre une décision médicale ». Lors d’un colloque le 11 décembre dernier, le Dr Alain Livartowski, responsable des projets e-santé à l’Institut Curie, a exprimé ses doutes sérieux face au manque de réflexion éthique préalable trop fréquent dans le déploiement de l’intelligence artificielle en santé. Il a rappelé la nécessité absolue d’une garantie humaine en toute décision. En janvier 2018, le Cnom (Conseil National de l’Ordre des Médecins) préconisait aussi, dans son Livre Blanc, le développement d’une société numérique qui reste « au service des soignants et des patients », recommandant que « les recours aux technologies ne puissent pas avoir la mission de remplacer la décision médicale ».

En imagerie médicale, l’intelligence artificielle est très performante. Un algorithme indiquant les risques de dégradation de l’état de santé d’un patient peut permettre de placer plus vite un malade en soins intensifs, améliorant ainsi sa prise en charge. Mais un algorithme qui prédit le risque de mortalité risquerait au contraire de « conditionner des choix, plus ou moins masqués, visant à réduire le coût des soins engagés ».

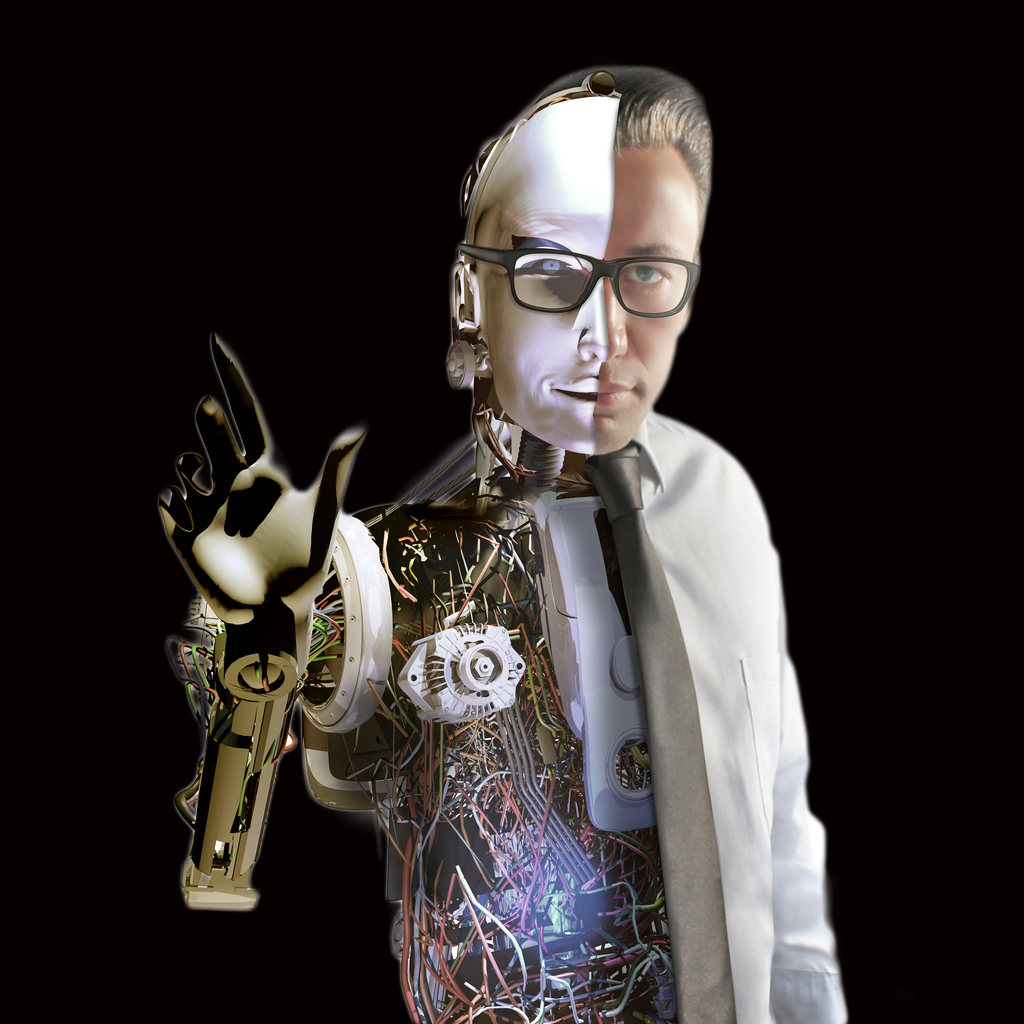

Certes, l’intelligence artificielle ne prend pas encore les décisions, mais elle y contribue, c’est là que se joue le débat. Car la particularité des technologies modernes de deep learning (auto-apprentissage), c’est que le raisonnement utilisé par l’ordinateur échappe désormais aux concepteurs. Que faire lorsque l’ordinateur et le médecin auront des avis divergents ? Qui croire ? « Osera-t-on aller contre l’opinion d’une machine qui traite des milliards de données à la seconde? » D’autant plus que ces algorithmes prennent mal en compte les minorités, c’est-à-dire ceux qui s’écartent de la norme statistique.

Les conclusions tirées par l’intelligence artificielle sont encore présentées comme des propositions, le tout est de choisir quelle valeur y est accordée. Car l’IA n’a pas d’états d’âme, elle est dépourvue « de ce qui fonde l’homme, la bienveillance ». Et ce manque d’empathie fait aussi partie de la nature des psychopathes ! « L’humain pour choisir a besoin de ses émotions. Or l’IA n’a pas d’émotions », martèle Judith Nicogossian, une anthopologiste qui tient le blog corpshybride.net. Lors des premiers essais, les assistants vocaux indiquaient le pont le plus proche à ceux qui exprimaient le désir de se suicider… Certains programmateurs modélisent des émotions, des modélisations « inévitablement partielles, sources de biais ». Mais pour Judith Nicogossian, « un robot semblant doué d’humanité alors qu’il ne fait qu’appliquer des lignes de code, c’est peut-être cela le plus grand danger ».

Le Figaro, Damien Mascret (04/01/2019)